Anthropicが実測:AIはどれだけ仕事を代替しているか

OpenAIのロボット部門責任者が辞任

以前 Caitlin Kalinowski で Orion ARメガネを担当していた人物が、2024年末に OpenAI に参加しロボットチームを率いていたが、米国防総省との軍事契約に同意できないとして辞職した。

2つのレッドライン:

彼女によれば、「裁判所の監督なしに米国民を監視すること」と「人間の許可なしに致死兵器を起動すること」という2点について、社内ではほとんど真剣な議論が行われていなかったという。

Anthropicは先に撤退:

Anthropic は厳しい制限条件を主張したため、国防総省との交渉が決裂したと、Fortune が報じている。その後、OpenAIが契約を締結した。

Altmanも認める:

Sam Altman もこの対応について「かなり日和見的に見える」と認めており、その後、国内監視と自律兵器の禁止条項が追加された。

OpenAIは以前、軍事利用を禁止していた?

OpenAIの利用規約はもともと軍事用途を明確に禁止していたが、2024年初めに静かに削除された。WIRED の報道によると、実際には禁止規定が残っていた時期にも、米国防総省は Microsoft を通じてOpenAIのモデルをテストしていたという。

OpenAIがAIセキュリティAgentを発表

OpenAIは新たに Codex Security を発表した。これは開発チームのために脆弱性を発見する AIエージェントで、コードを自動スキャンし、脆弱性の深刻度を判断し、修正方法まで提示する。

理解してから検出:

まずコード構造を理解し、専用の脅威モデルを構築。そのモデルに基づいて脆弱性を探し、サンドボックス環境で検証することも可能。

ノイズ大幅減少:

非公開テストでは誤検知率が 50%以上減少。あるプロジェクトではノイズが 84%削減、深刻度の誤判定も 90%以上減少した。

1か月無料:

現在は ChatGPT Pro / Enterprise / Business / Edu ユーザー向けに公開されており、research preview期間の最初の1か月は無料。

他社も参入:

Anthropicも数週間前に Claude Code Security を発表しており、同様にコードをスキャンして脆弱性を見つけ、修正案を提示する機能を提供している。

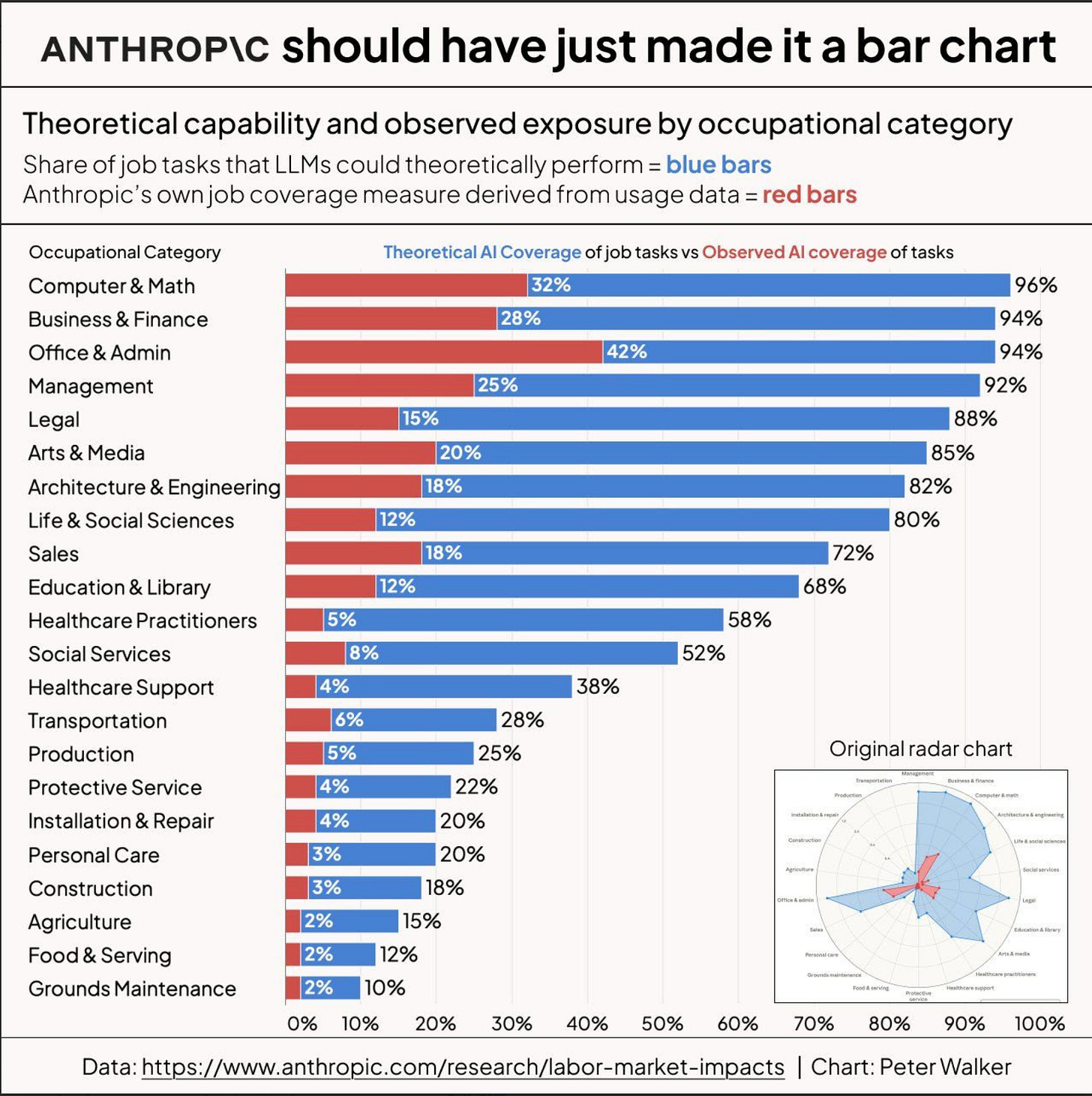

Anthropicが実測:AIはどれだけ仕事を代替しているか

Anthropicは Claudeの実際の使用データをもとに、新しい指標を作り、AIがどれだけ仕事を代替しているのかを分析した。その結果、理論上可能な範囲と実際の利用には大きな差があることが分かった。

大きなギャップ:

コンピュータ・数学分野では、理論上AIは 94%のタスクを処理できるが、Claudeの実際の利用は 33% にとどまる。他分野では差はさらに大きい。