アフリカではすでに成果を出し始めている中国企業がいくつか出てきている。

テスラ、スペースX、xAIが自社AIチップ工場を建設

テスラ、スペースX、xAIが自社AIチップ工場を建設

イーロン・マスクは「Terafab」計画を正式発表。テスラとスペースXが共同で自社の半導体工場を建設する。既存のチップサプライヤーの増産スピードは「自社の需要を大きく下回っている」とし、自前での製造に踏み切る。

200億ドル規模:工場はGiga Texas北部に建設予定。目標は2nmプロセス。初期は月産10万枚のウェハー、フル稼働時には月産100万枚を目指す。これはTSMCの世界生産能力の約70%に相当。

2種類のチップ:1つはテスラ車、Cybercab、Optimusロボット向け。もう1つは「D3」と呼ばれるチップで、SpaceXの軌道AI衛星向けに設計されている。

計算力の80%を宇宙へ:マスクによると、宇宙の太陽放射は地上の約5倍で、真空環境は放熱にも優れる。そのためTerafabの算力の約80%を宇宙へ投入する計画。SpaceXはすでにFCCに対し、100万基の衛星による軌道データセンター構築を申請済み。

実現可能性:テスラは半導体製造の実績がなく、2020年に掲げた「4680バッテリー」の量産も5年以上経ってなお目標未達。チップ製造はそれ以上に難易度が高い。

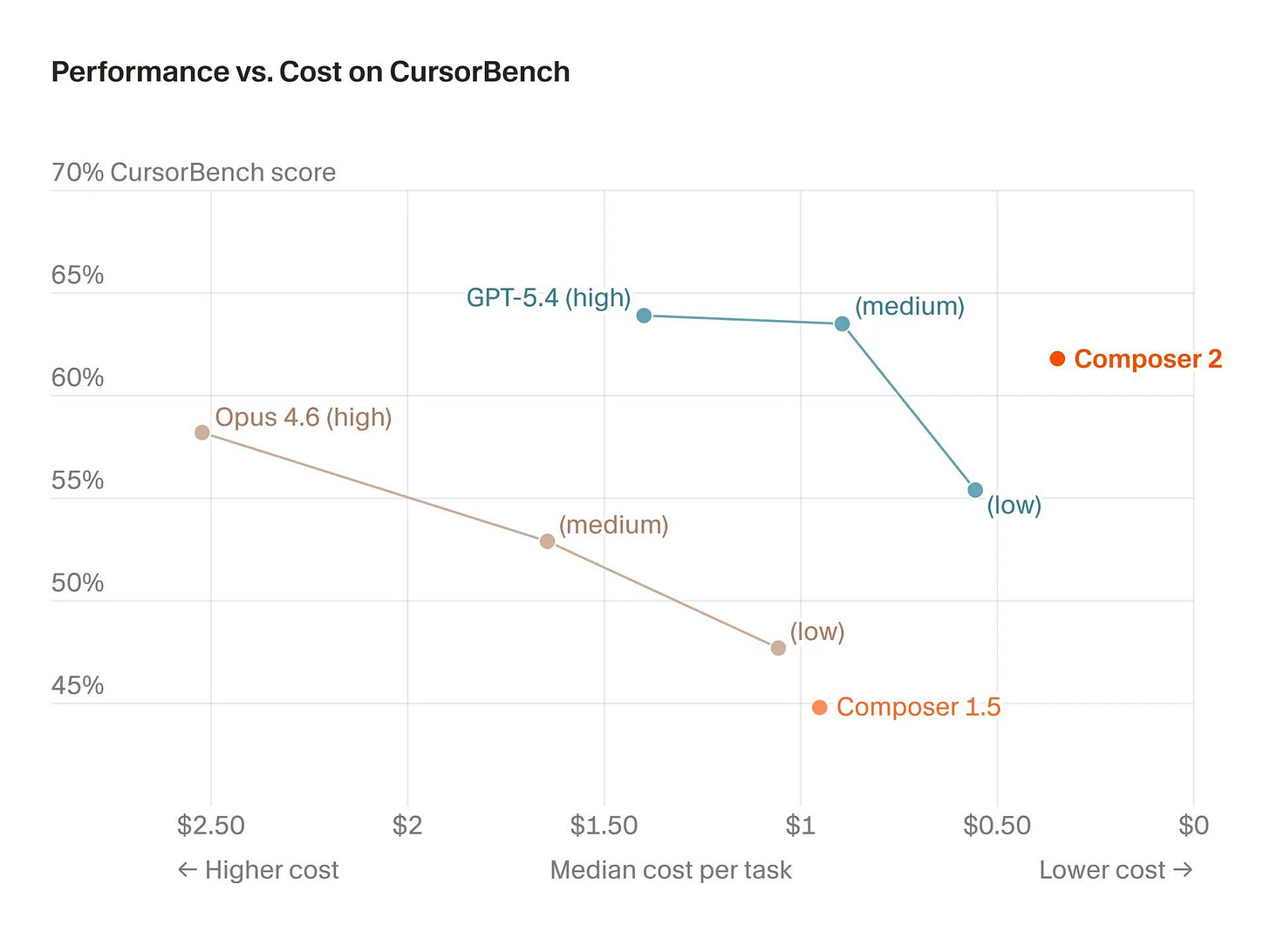

Cursor、自社訓練モデル「Composer 2」を発表

Cursorは外部モデル依存から脱却し、自社開発のコーディングモデル「Composer 2」を公開。高性能かつ低価格を実現。

大幅な性能向上:CursorBenchで61.3点(前モデル44.2点から約40%向上)。SWE-bench Multilingualでも65.9から73.7へ改善。

2つの価格帯:標準版は入力$0.50/M、出力$2.50/M。高速版は$1.50/$7.50で、デフォルトは高速版。

トレーニング手法:独自の継続事前学習(continued pretraining)と強化学習を組み合わせ、数百ステップを要する長タスクへの対応力を強化。

基盤モデル:モデルIDの解析から、Kimi K2.5がベースである可能性が指摘。公式は当初非公表だったが、最終的に商用ライセンスで解決。

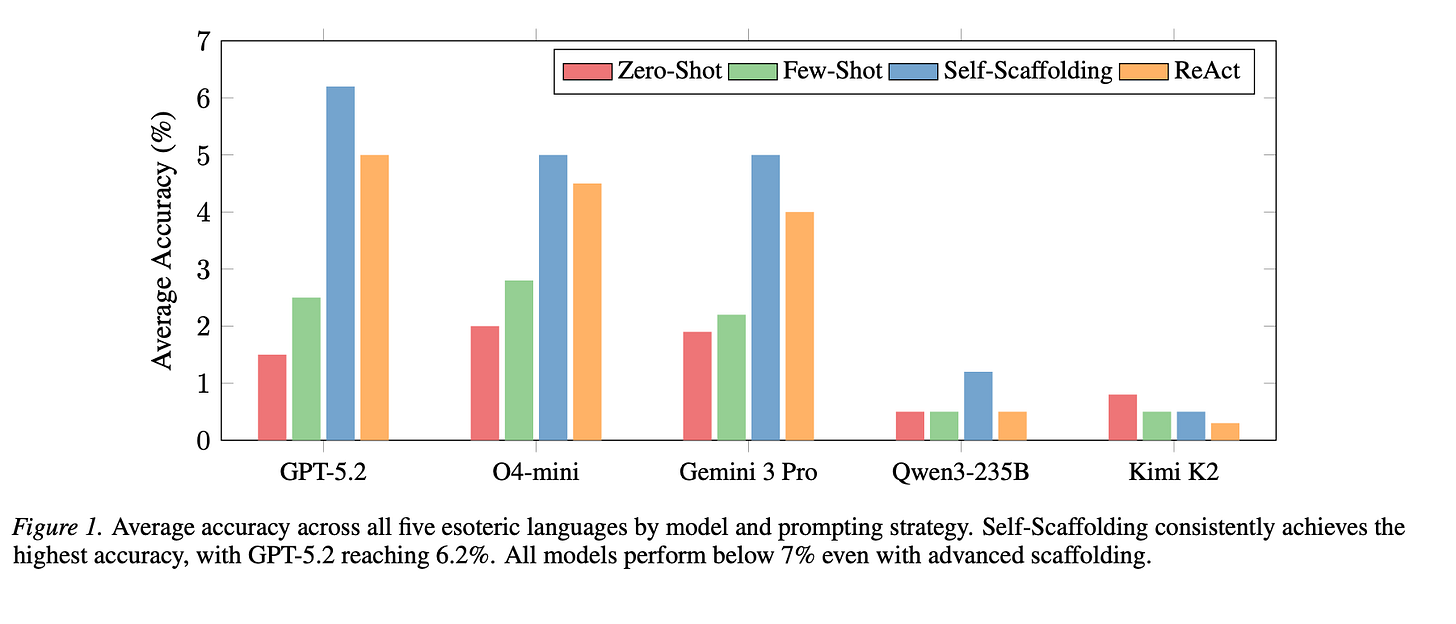

LLMのコーディング能力は「記憶依存」

ICLR 2026ワークショップの研究「EsoLang-Bench」では、5種類のマイナー言語でLLMを評価。従来ベンチで85〜95%のモデルが、0〜11%まで精度低下。

記憶と推論の乖離:Brainfuck、Whitespace、Shakespeareなど、データ量が極端に少ない言語を使用。LLMは学習データに依存していることが明確に。

最高でも1割:GPT-5.2、o4-mini、Gemini 3 Pro、Qwen3-235B、Kimi K2 Thinkingなど全モデルが苦戦。最高のGPT-5.2でも11.2%にとどまる。

改善手法も限定的:few-shot、自己修正、マルチエージェントでも大きな改善なし。

ツール活用:CodexやClaude Codeで精度は約2倍になるが、それでも最大13.8%と限定的。

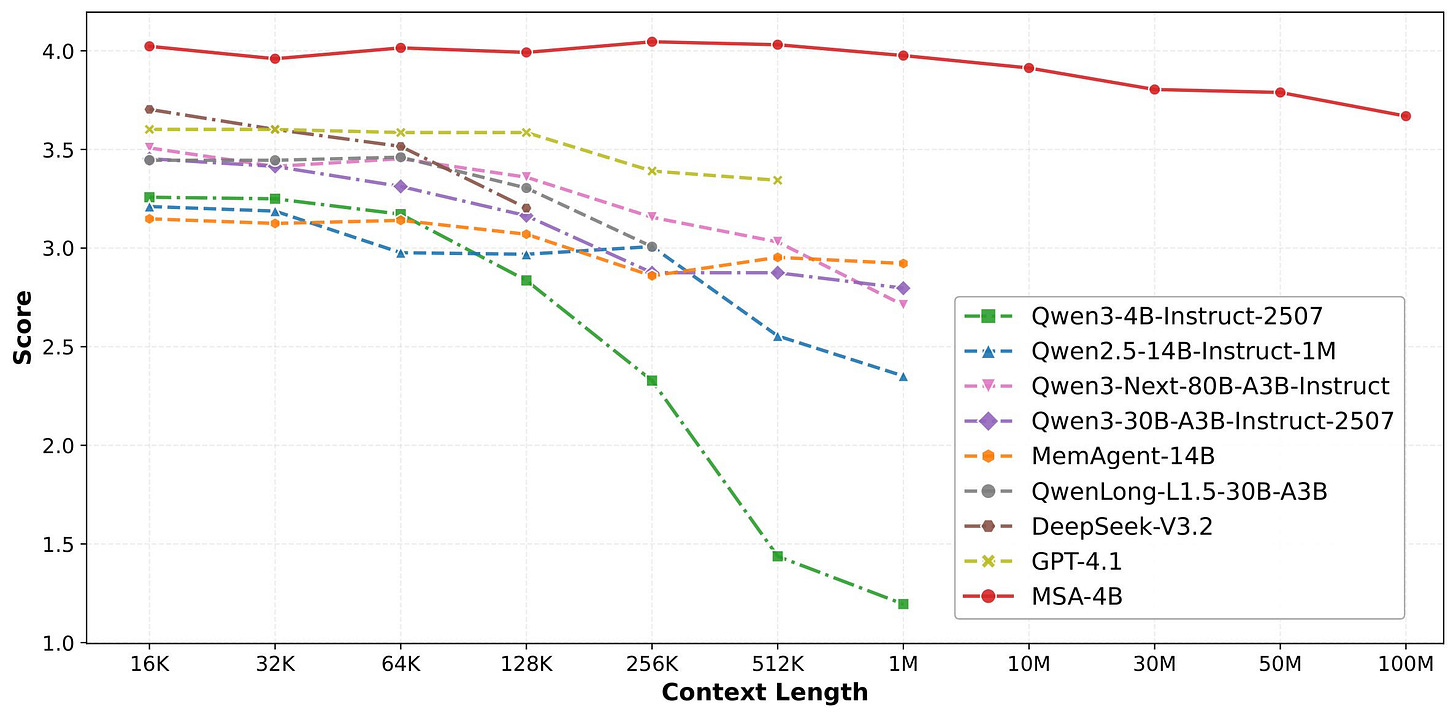

AIに「本当に記憶させる」新手法

EverMindは長期記憶を扱う新手法「MSA(Memory Sparse Attention)」を提案。最大1億トークンのコンテキスト処理が可能。

RAGの限界:RAGは本質的に検索ベースであり、複数文書を横断する推論には弱い。KVキャッシュ圧縮も精度劣化が問題。

MSAの特徴:document-wise RoPEで文書境界を認識し、Memory Interleaveで分散した記憶間の多段推論を実現。

小モデルの優位性:4Bモデルでも235BクラスのRAGシステムを上回る性能を達成。

RAGの今後:大規模データ処理では依然有効だが、複雑な推論ではMSAのようなアプローチが優位。

Karpathy「コーディングという動詞は不要になる」

Andrej KarpathyはNo Priors Podcastで、「もはや自分でコードを書くことはない」と発言。